Исследователи Apple разработали модель ИИ, которая значительно улучшает снимки в условиях экстремально темного освещения, интегрируя модель изображения на основе диффузии непосредственно в конвейер обработки изображений камеры. Это позволяет восстанавливать детали из необработанных данных сенсора, которые обычно теряются. Вот как они это сделали.

Проблема экстремальных фотографий при слабом освещении

Вы, вероятно, делали фотографии в очень темных условиях, в результате чего изображение было заполнено зернистым цифровым шумом.

Это происходит, когда датчик изображения не улавливает достаточно света.

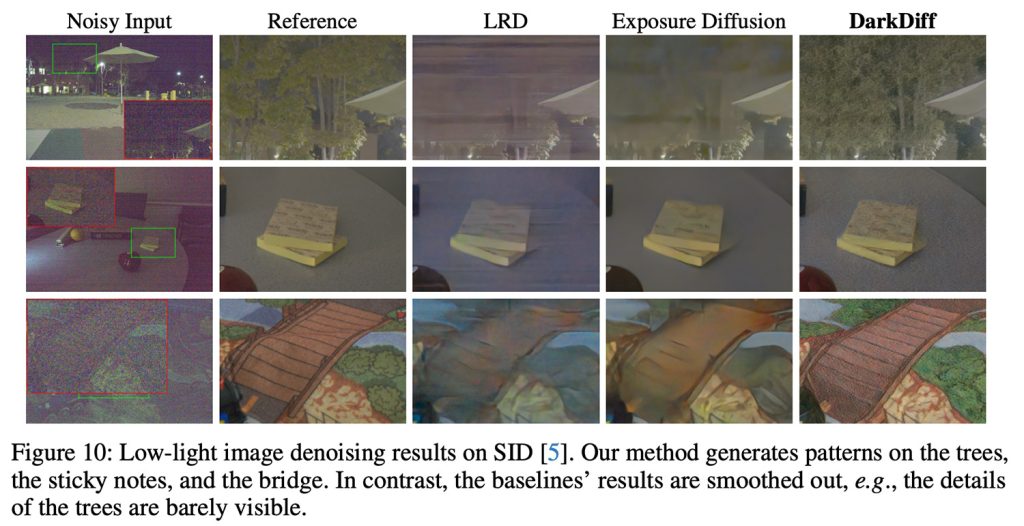

Чтобы попытаться компенсировать это, такие компании, как Apple, применяют алгоритмы обработки изображений, которые подвергались критике за создание чрезмерно сглаженных эффектов, похожих на масляную живопись, где мелкие детали исчезают или преобразуются во что-то едва различимое или читаемое.

Представляем DarkDiff

Для решения этой проблемы исследователи из Apple и Университета Пердью разработали модель под названием DarkDiff. Вот как они представляют ее в исследовании под названием DarkDiff: Advancing Low-Light Raw Enhancement by Retasking Diffusion Models for Camera ISP:

Высококачественная съемка в условиях экстремально слабого освещения является сложной, но важной задачей для цифровых камер. Благодаря передовым вычислительным аппаратным средствам, традиционные алгоритмы обработки изображений (ISP) камер постепенно заменяются эффективными глубокими нейронными сетями, которые более интеллектуально улучшают зашумленные необработанные изображения. Однако существующие регрессионные модели часто минимизируют ошибки пикселей и приводят к чрезмерному сглаживанию фотографий при слабом освещении или глубоких теней. Последние работы пытались решить это ограничение, обучая диффузионную модель с нуля, но эти модели все еще испытывают трудности с восстановлением четких деталей изображения и точных цветов. Мы представляем новую структуру для улучшения необработанных изображений при слабом освещении путем перепрофилирования предварительно обученных генеративных диффузионных моделей с помощью ISP камеры. Обширные эксперименты демонстрируют, что наш метод превосходит современные аналоги по перцептивному качеству на трех сложных наборах данных необработанных изображений при слабом освещении.

Другими словами, вместо применения ИИ на этапе постобработки, они перепрофилировали Stable Diffusion (модель с открытым исходным кодом, обученную на миллионах изображений), чтобы она понимала, какие детали *должны* присутствовать в темных областях фотографий, учитывая их общий контекст, и интегрировали ее в конвейер обработки изображений.

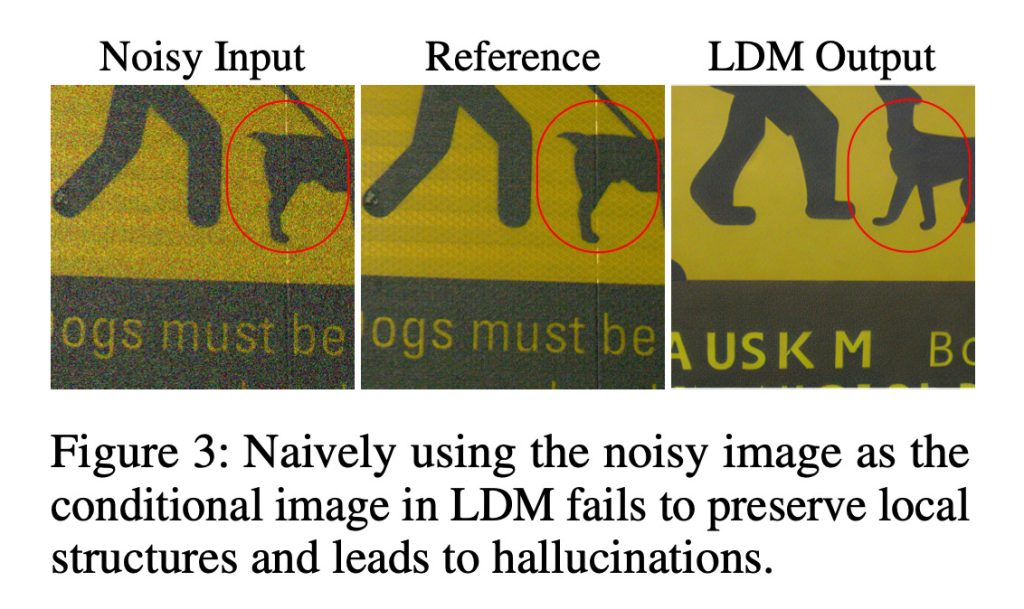

Фактически, их подход вводит механизм, который вычисляет внимание к локализованным участкам изображения, что помогает сохранить локальные структуры и смягчает галлюцинации, как на изображении ниже, где ИИ реконструкции полностью изменяет содержимое изображения.

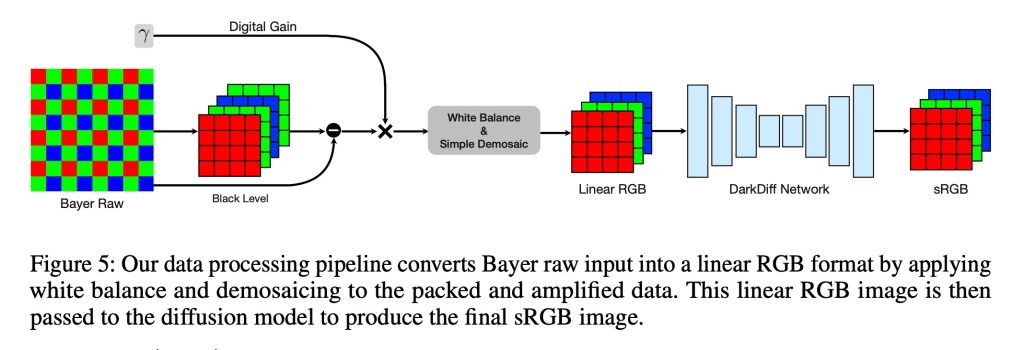

С помощью этого подхода ISP камеры по-прежнему выполняет раннюю обработку, необходимую для интерпретации необработанных данных сенсора, включая такие шаги, как баланс белого и демозаика. Затем DarkDiff работает с этим линейным RGB-изображением, удаляя шум и напрямую создавая окончательное sRGB-изображение.

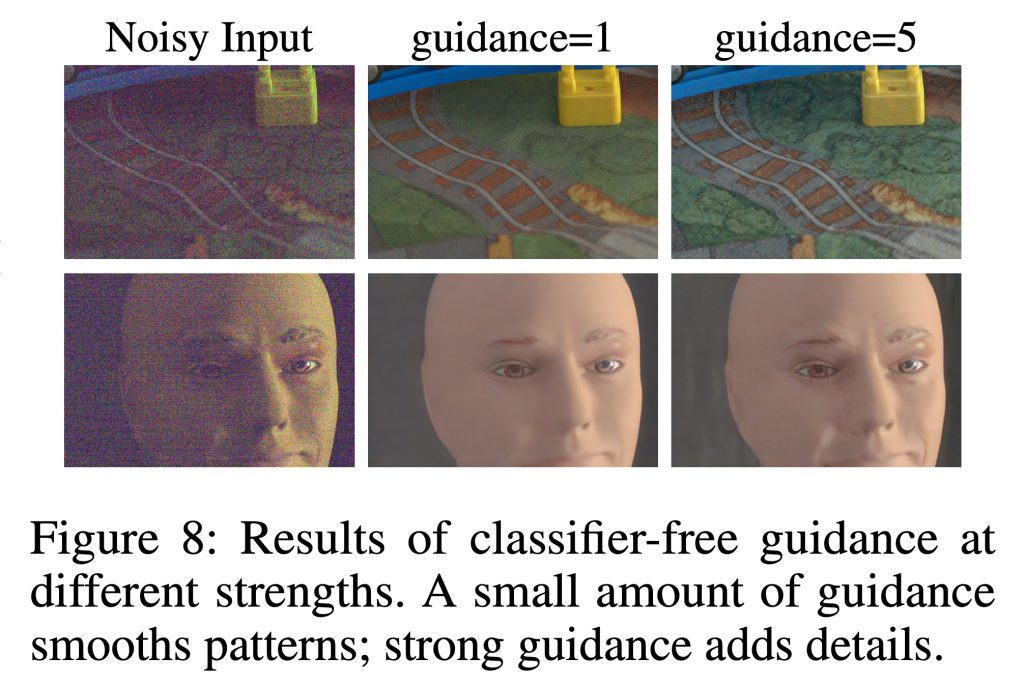

DarkDiff также использует стандартный метод диффузии, называемый свободной от классификатора направляющей силой, которая, по сути, контролирует, насколько сильно модель должна следовать входному изображению по сравнению с ее изученными визуальными априорными данными.

При более низком значении направляющей силы модель создает более гладкие узоры, тогда как увеличение направляющей силы побуждает ее генерировать более четкие текстуры и мелкие детали (что, в свою очередь, также увеличивает риск возникновения нежелательных артефактов или галлюцинированного контента).

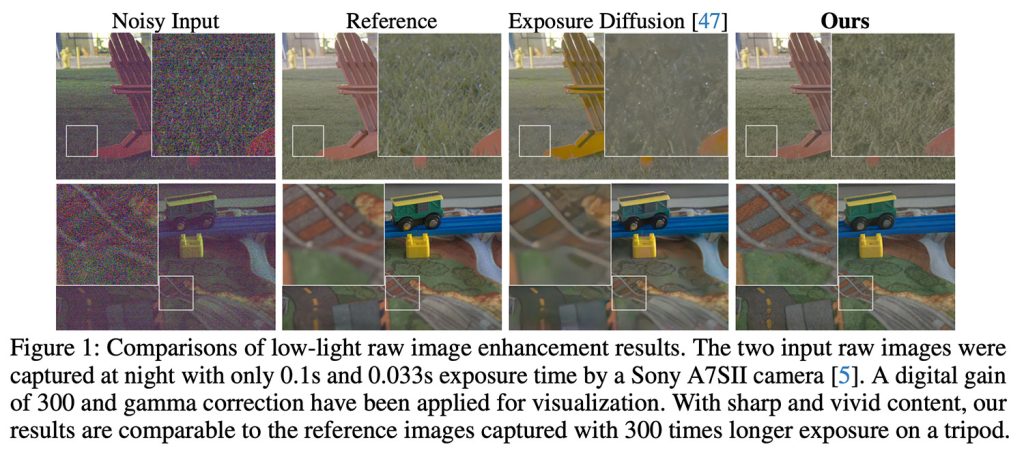

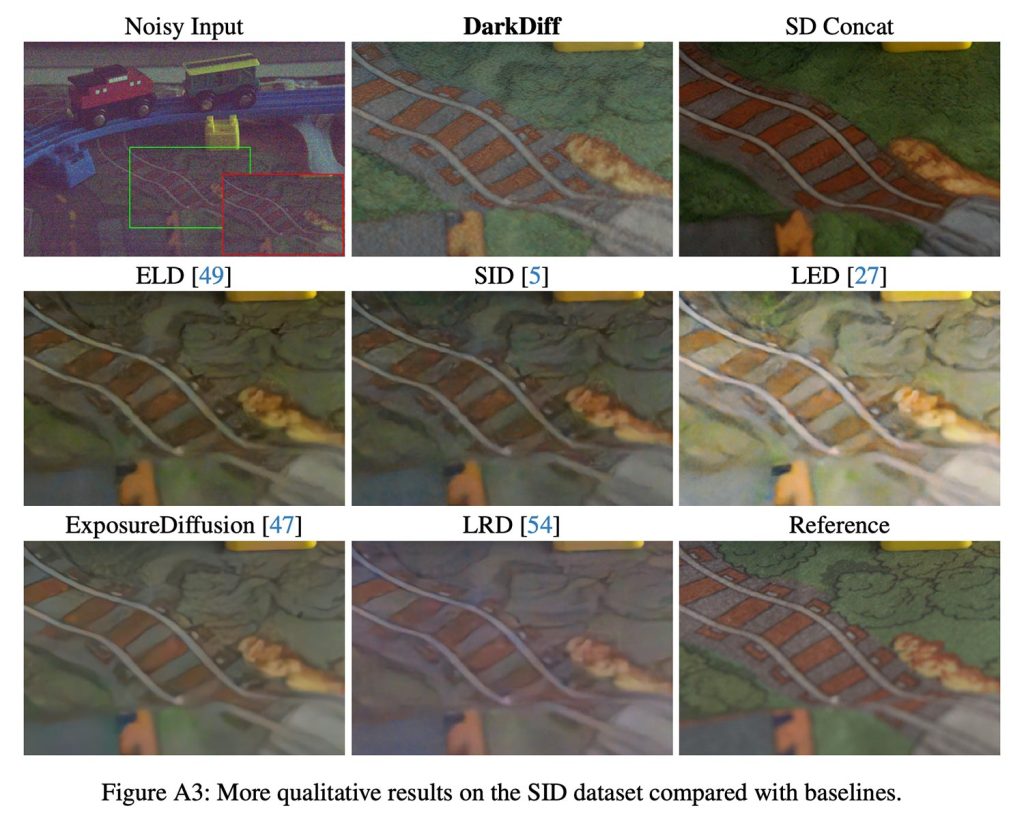

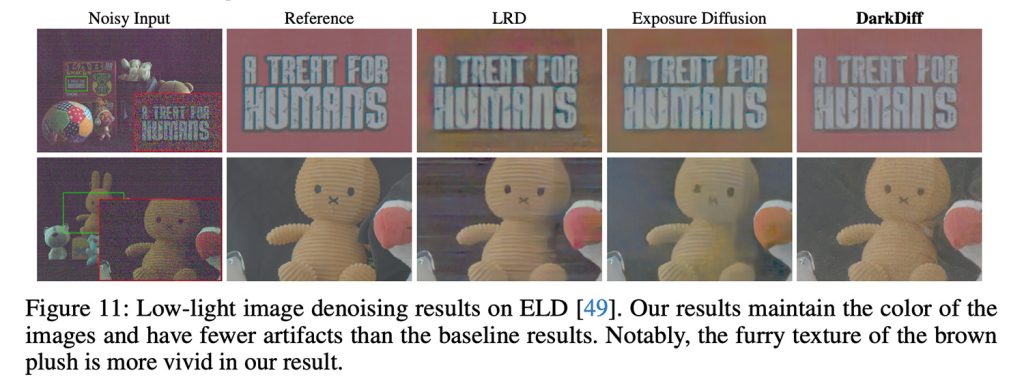

Чтобы протестировать DarkDiff, исследователи использовали реальные фотографии, сделанные при экстремально слабом освещении камерами, такими как Sony A7SII, сравнивая результаты с другими моделями улучшения необработанных изображений и диффузионными базовыми линиями, включая ExposureDiffusion.

Тестовые изображения были сняты ночью с выдержкой до 0,033 секунды, а улучшенные версии DarkDiff сравнивались с эталонными фотографиями, снятыми с выдержкой в 300 раз длиннее на штативе.

Вот некоторые из результатов (которые мы рекомендуем увидеть в полном качестве в оригинальном исследовании):

DarkDiff не лишен недостатков

Исследователи отмечают, что их обработка на основе ИИ значительно медленнее традиционных методов, и, вероятно, потребует облачной обработки для компенсации высоких вычислительных требований, которые быстро разрядят батарею, если выполнять их локально на телефоне. Кроме того, они также отмечают ограничения с распознаванием неанглийского текста в сценах с плохим освещением.

Важно также отметить, что нигде в исследовании не предполагается, что DarkDiff появится на iPhone в ближайшее время. Тем не менее, эта работа демонстрирует постоянное внимание Apple к достижениям в области вычислительной фотографии.

В последние годы это стало областью растущего интереса на всем рынке смартфонов, поскольку покупатели требуют от камер возможностей, превосходящих то, что компании могут физически разместить внутри своих устройств.

Чтобы прочитать полное исследование и ознакомиться с дополнительными сравнениями DarkDiff с другими методами шумоподавления, перейдите по этой ссылке.

Скидки на аксессуары на Amazon