Приложения для повышения продуктивности, оснащенные обещаниями «искусственного интеллекта», становятся все более распространенными. От приоритизации задач до поддержания фитнес-режима — кажется, существует приложение для повышения продуктивности на базе ChatGPT практически для любого новогоднего обещания. Однако, на мой взгляд, это начало предостерегающей истории.

9to5Mac Security Safe Space эксклюзивно предоставлен компанией Mosyle, единственной унифицированной платформой Apple. Мы занимаемся тем, чтобы устройства Apple были готовы к работе и безопасны для бизнеса. Наш уникальный интегрированный подход к управлению и безопасности сочетает в себе передовые решения безопасности, специфичные для Apple, для полностью автоматизированного усиления безопасности и соответствия требованиям, EDR следующего поколения, основанное на ИИ нулевое доверие и эксклюзивное управление привилегиями, с самым мощным и современным MDM для Apple на рынке. Результатом является полностью автоматизированная унифицированная платформа Apple, которой в настоящее время доверяют более 45 000 организаций, чтобы без усилий и по доступной цене сделать миллионы устройств Apple готовыми к работе. Запросите свой РАСШИРЕННЫЙ ТРИАЛ сегодня и поймите, почему Mosyle — это все, что вам нужно для работы с Apple.

Это Safe Space, еженедельная колонка, посвященная безопасности на 9to5Mac, где каждое воскресенье Arin Waichulis обсуждает последние новости о конфиденциальности данных, уязвимостях и возникающих угрозах в экосистеме Apple с более чем 2 миллиардами активных устройств.

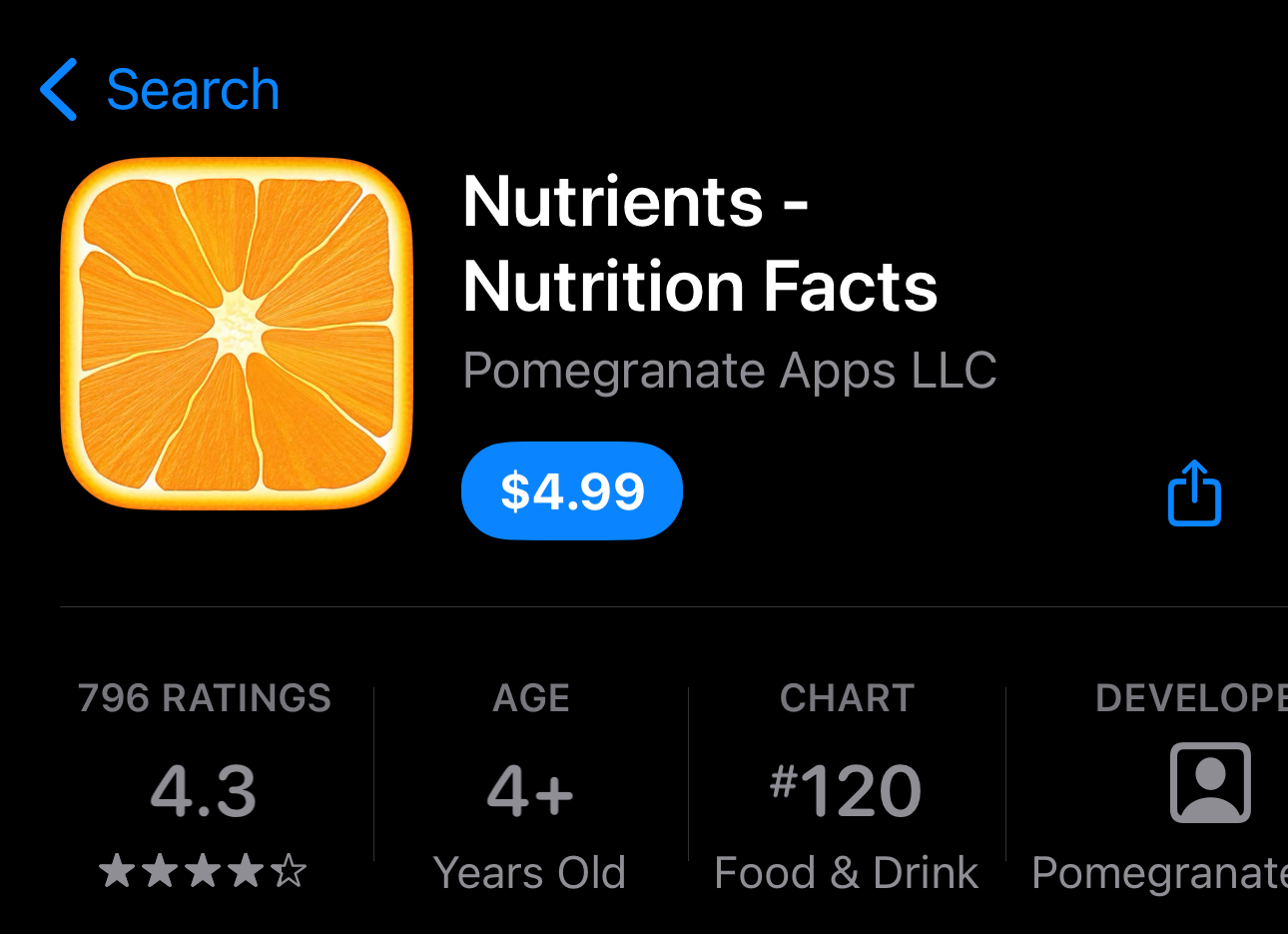

В марте 2023 года OpenAI выпустила API ChatGPT, который сразу же был принят крупными игроками, такими как Snapchat, для своего чат-бота My AI, а также Instacart, Quizlet и Shopify для своего потребительского приложения Shop. Однако, из-за довольно свободных условий обслуживания API, которые можно описать как «если у вас есть пульс, вы в порядке», разработчики быстро заполнили App Store приложениями, связанными с продуктивностью, использующими плагины ChatGPT.

Недавнее расследование политик конфиденциальности популярных приложений для личной продуктивности, проведенное исследователями безопасности из Private Internet Access (PIA), выявило «тревожные» примеры плохой прозрачности. Одно конкретное приложение представляло собой популярный ИИ-чат-ассистент, который использует API ChatGPT и свою существующую базу данных для адаптации ответов к запросам пользователя.

Несмотря на то, что на странице приложения в App Store утверждалось, что оно использует только сообщения и идентификаторы устройств для улучшения функциональности приложения и управления учетными записями, «его реальная практика обработки данных скрыта в политике конфиденциальности, которая гласит, что оно собирает ваше имя и адрес электронной почты, статистику использования и информацию об устройстве», — заявляет PIA. Нередко приложения собирают такие пользовательские данные для продажи третьим сторонам или для создания подробных профилей для персонализированной рекламы.

Это капля в море по сравнению с натиском приложений для еды, здоровья и продуктивности на базе ChatGPT, которые доступны прямо сейчас в App Store. Кодирование с помощью ИИ, советы по личной фитнесу, перевод — без необходимости разбираться в политиках и практиках обработки данных каждого из них, есть ли здесь более важный вывод?

Вскоре после взрывной популярности ChatGPT в январе 2023 года регулирующие органы и законодатели выразили серьезную обеспокоенность по поводу использования персональных данных в его обучающих данных. Италия даже временно запретила сервис в прошлом году до внедрения лучших уведомлений о конфиденциальности.

Существует два способа, которыми ChatGPT получает доступ к личной информации.

Первый — это обучение большой языковой модели (LLM) на основе массовых данных. Эти загрузки в основном включают огромные объемы работ без разрешения, такие как статьи, книги, сообщения в блогах и другие источники текста, собранные со всего Интернета.

Однако наиболее заметным в данном случае является обращение через ChatGPT или одно из множества приложений, использующих его API. Поскольку чат-бот предназначен для ведения диалога, это может создать ложное чувство безопасности, побуждая пользователей делиться конфиденциальной информацией, такой как имена, адреса, данные о здоровье, финансовая информация и другие личные сведения, которыми они обычно не стали бы делиться. Любая предоставленная информация, будь то личная или нет, хранится OpenAI и, насколько нам известно, никогда не удаляется.

Хотя компания утверждает, что хранящиеся данные хранятся без личных идентификаторов, то есть анонимно, я настоятельно не рекомендую делиться чем-либо личным. В конце концов, при регистрации в ChatGPT требуется номер телефона, чтобы помочь платформе предотвратить спам-ботов. Это само по себе вызывает обеспокоенность по поводу анонимности пользователей.

Следует ли избегать приложений с интеграцией ChatGPT? Не совсем. Но важно проявлять осторожность в отношении всего, куда вы вводите личную или конфиденциальную информацию. Ложное чувство безопасности может привести к неосознанному обмену конфиденциальными данными. А между киберпреступниками и сомнительными политиками конфиденциальности то, чем вы делитесь с этими приложениями, может оказаться где угодно.